KI-Rechenzentren Deutschland 2026: GPU-Infrastruktur und Glasfaserbedarf

KI-Rechenzentren Deutschland 2026: GPU-Infrastruktur und Glasfaserbedarf

KI Rechenzentrum Deutschland, GPU Cluster Glasfaser und AI Infrastruktur stehen vor einem fundamentalen Wandel: Mit der Inbetriebnahme von Deutschlands erster KI-Fabrik in München mit 10.000 Blackwell-GPUs und einer Rechenleistung von 0,5 ExaFLOPS entstehen völlig neue Anforderungen an die Glasfaser-Verkabelung. Die exponentiell wachsenden GPU-Cluster benötigen hochdichte Glasfaserlösungen mit bis zu 96 Fasern auf 1HE, während gleichzeitig Übertragungsgeschwindigkeiten von 1,6 bis 3,2 Terabit pro Sekunde zum neuen Standard werden.

Der Paradigmenwechsel: Von klassischen Rechenzentren zu KI-getriebenen GPU-Clustern

Die deutsche Rechenzentrumslandschaft erlebt eine beispiellose Transformation. Bis 2030 werden sich die Kapazitäten für KI-Rechenzentren von derzeit 530 Megawatt auf 2.020 Megawatt vervierfachen. Diese Expansion konzentriert sich hauptsächlich auf die Standorte Frankfurt-Rhein-Main mit über 1.100 Megawatt installierter Kapazität und Berlin-Brandenburg als zweitem großen KI-Zentrum.

Die technischen Herausforderungen dieser Entwicklung sind enorm. Ein einzelner NVIDIA HGX B200-Server mit acht Blackwell-GPUs benötigt bis zu 16 Glasfaserverbindungen allein für das Netzwerk-Fabric. Bei Clustern mit tausenden Rechenknoten entstehen hunderttausende bis Millionen Verbindungen, die alle in kompakten Rack-Bereichen untergebracht werden müssen.

- Latenzanforderungen von unter 1 Mikrosekunde zwischen GPU-Clustern

- Bandbreiten von 260 Terabyte pro Sekunde in einem einzelnen NVL72-System

- Vollständige Redundanz für 99,999% Verfügbarkeit

- Skalierbarkeit für zukünftige 3,2 Terabit-Verbindungen

GPU-Cluster-Architektur: Neue Dimensionen der Glasfaservernetzung

Die Kommunikation innerhalb moderner GPU-Cluster erfolgt auf mehreren hierarchischen Ebenen mit unterschiedlichen technischen Anforderungen. Auf der Intra-Node-Ebene ermöglicht NVLink 5.0 eine bidirektionale Bandbreite von 1,8 Terabyte pro Sekunde zwischen benachbarten GPUs – das 14-fache von PCIe Gen 6.

| Verbindungsebene | Technologie | Bandbreite | Latenz |

|---|---|---|---|

| Intra-Node (GPU zu GPU) | NVLink 5.0 | 1,8 TB/s bidirektional | < 200 Nanosekunden |

| Inter-Node (Server zu Server) | 800G/1,6T Ethernet | 800 Gbit/s – 1,6 Tbit/s | < 1 Mikrosekunde |

| Cluster-Backbone | MPO/MTP-Systeme | 3,2 Tbit/s (geplant) | < 5 Mikrosekunden |

Diese extremen Anforderungen treiben die Entwicklung neuer Glasfaserlösungen voran. Die PAM4-Modulation ermöglicht eine Verdoppelung der Datenrate pro optischer Leitung ohne Erhöhung der Sendegeschwindigkeit. Gleichzeitig werden neue Transceiver-Standards mit 100 Gbit/s pro Leitung bei 120 GBaud Modulationsraten eingeführt.

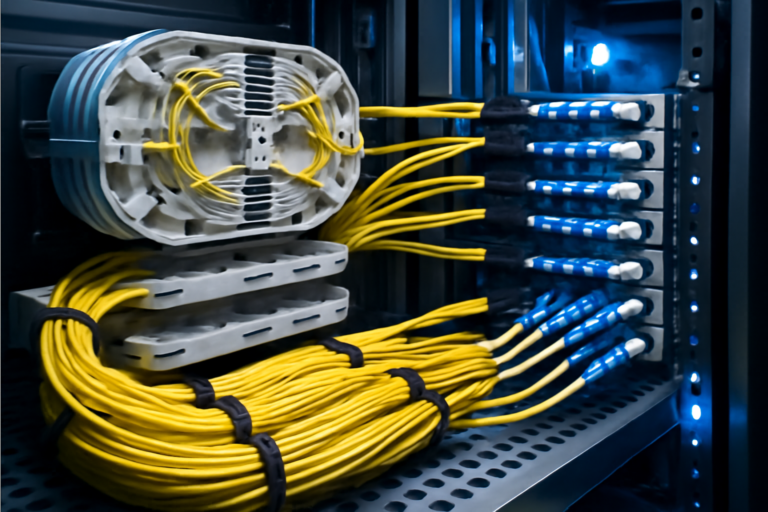

Hochdichte-Spleißsysteme: Die Antwort auf exponentiell wachsende Faserzahlen

Die physische Realisierung dieser Bandbreitendichten erfordert revolutionäre Ansätze in der Glasfaserinfrastruktur. Moderne modulare Spleißsysteme erreichen heute bis zu 96 Fasern auf einer Höheneinheit (1HE) – eine Steigerung von 47 Prozent gegenüber konventionellen Systemen mit 48-72 Fasern.

Fiber Products Qualitätsversprechen: Als offizieller Diamond-Partner und Hersteller fertigen wir modulare Spleißsysteme in Europa. Profitieren Sie von Schweizer Präzision und 5 Jahren Garantie auf unsere Systeme.

Bei der Terminierung von 10.000 Fasern bedeutet dies konkret: Statt 105 Höheneinheiten mit konventionellen 48-Port-Systemen werden nur noch 55 Höheneinheiten mit hochdichten 96-Port-Systemen benötigt. Die eingesparten 50 Höheneinheiten entsprechen mehr als einem kompletten Rack mit erheblichen Einsparungen bei Stellfläche, Klimatisierung und Stromversorgung.

- Vorkonfektionierte Module mit werksseitig montierten Kupplungen

- Integrierte Spleißkassetten für 35% schnellere Installation

- Austauschbare Frontmodule für LC, SC, E2000 und MPO/MTP

- Flexible Bestückung von minimal bis maximal 288 Fasern pro System

Ribbon-Spleißtechnik: Effizienzsteigerung für KI Rechenzentrum Deutschland

Mit der Zunahme von GPU Cluster Glasfaser 800G erlebt die Ribbon-Spleißtechnik eine Renaissance. Diese Technologie ermöglicht das gleichzeitige Spleißen von 12 Fasern in der Zeit, die konventionell für eine einzelne Faser benötigt wird – eine zwölffache Geschwindigkeitssteigerung.

Moderne Ribbon-Spleißgeräte garantieren dabei eine gleichbleibend hohe Qualität mit Einfügedämpfungen unter 0,1 dB. Für Rechenzentrumsverbindungen zwischen spezialisierten GPU-Clustern ermöglicht dies massive Zeit- und Kosteneinsparungen bei gleichzeitig höherer Packungsdichte.

MPO/MTP-Steckverbinder: Der Standard für AI Infrastruktur

Die Wahl des richtigen Steckertyps ist entscheidend für die Performance moderner KI-Rechenzentren. MPO (Multi-fiber Push-On) und MTP (Mechanical Transfer Pull-On) Steckverbinder dominieren bei hochdichten GPU-Cluster-Installationen.

| Steckertyp | Faserzahl | Anwendung | Übertragungsrate |

|---|---|---|---|

| MPO-12 | 12 Fasern | 40G/100G Backbone | bis 100 Gbit/s |

| MPO-24 | 24 Fasern | 400G/800G Cluster | bis 800 Gbit/s |

| MTP-16 | 16 Fasern | 1,6T GPU-Vernetzung | bis 1,6 Tbit/s |

Ein einzelner 800G-Switch-Port kann flexibel in zwei 400G-GPU-Verbindungen aufgeteilt werden, während 1,6T und 3,2T Ports noch komplexere Breakout-Konfigurationen ermöglichen. Diese Flexibilität optimiert die Gesamtbetriebskosten und erlaubt zukunftssichere Upgrades.

Flüssigkeitskühlung und Glasfaserführung: Neue Herausforderungen

Die enormen Leistungsdichten moderner GPU-Cluster mit bis zu 120 kW pro Rack erfordern Flüssigkeitskühlung. Dies stellt besondere Anforderungen an die Glasfaserführung, da Kabel und Kühlungsleitungen im gleichen Raum koexistieren müssen.

- Temperaturbeständige Kabel für Umgebungstemperaturen bis 70°C

- Wasserdichte Durchführungen mit Schutzart IP65

- Getrennte Kabelwege für Signal- und Kühlungsleitungen

- Flexible Kabelführung für Wartungszugang zu Kühlsystemen

Die modularen Glasfaserlösungen für Rechenzentren müssen diese speziellen Anforderungen von Anfang an berücksichtigen. Vorkonfektionierte Systeme mit durchdachtem Kabelmanagement reduzieren Installationsfehler und beschleunigen die Inbetriebnahme.

Stromversorgung und Glasfaserinfrastruktur: Die kritische Verbindung

KI Rechenzentrum Deutschland Standorte benötigen nicht nur massive Rechenleistung, sondern auch entsprechende Stromversorgung. Die geplanten 2.020 Megawatt bis 2030 erfordern neue Ansätze in der Energieverteilung und damit verbundene Steuerungs- und Überwachungssysteme.

Glasfaserkabel spielen hier eine doppelte Rolle: Sie übertragen nicht nur Daten zwischen GPU-Clustern, sondern verbinden auch die intelligenten Stromverteilungssysteme. Die elektromagnetische Immunität von Glasfasern ist dabei ein entscheidender Vorteil in der Nähe von Hochspannungsanlagen und Transformatoren.

Zukunftssicherheit durch modulare Systeme

Die rasante Entwicklung der AI Infrastruktur erfordert maximale Flexibilität. Das VarioConnect 3HE System bietet mit 144 bis 288 Fasern pro Einheit die notwendige Skalierbarkeit für wachsende Anforderungen.

Die konsequent modulare Architektur ermöglicht eine stufenweise Erweiterung ohne Betriebsunterbrechung. Austauschbare Frontmodule erlauben die Migration von älteren Steckertypen zu modernen MPO/MTP-Systemen, während die Grundinfrastruktur erhalten bleibt.

- Investitionsschutz durch 5 Jahre Herstellergarantie

- Kompatibilität zwischen verschiedenen Produktgenerationen

- Vorbereitung für 3,2 Terabit-Übertragungsraten

- Unterstützung aller gängigen Steckertypen (LC, SC, E2000, MPO)

Normkonformität und Zertifizierung für GPU Cluster Glasfaser

Die Einhaltung internationaler Normen ist für KI-Rechenzentren essentiell. Alle Komponenten müssen den Standards IEC 61754 für Steckverbinder und IEC 61753 für passive Komponenten entsprechen.

| Norm | Bereich | Anforderung |

|---|---|---|

| IEC 61754-15 | MPO-Steckverbinder | Mechanische Schnittstelle |

| IEC 61753-1 | Passive Komponenten | Umweltbeständigkeit |

| IEC 61300-3-35 | Dämpfungsmessung | < 0,25 dB Einfügedämpfung |

| DIN EN 50173-1 | Verkabelungsstruktur | Rechenzentrumsstandard |

Die Zertifizierung nach diesen Standards gewährleistet Interoperabilität zwischen verschiedenen Herstellern und langfristige Betriebssicherheit. Als Diamond-Partner und Hersteller garantiert Fiber Products die vollständige Normkonformität aller Systeme.

Praktische Umsetzung: Von der Planung zur Installation

Die erfolgreiche Implementation einer KI-Rechenzentren Glasfaser GPU-Cluster erfordert systematische Planung. Beginnend mit der Bedarfsanalyse über die Systemauswahl bis zur finalen Installation müssen alle Schritte präzise aufeinander abgestimmt sein.

Zunächst erfolgt die Kapazitätsplanung basierend auf aktuellen und prognostizierten GPU-Zahlen. Bei einem typischen Ausbau mit 1.000 GPUs entstehen etwa 16.000 Glasfaserverbindungen, die strukturiert terminiert werden müssen. Die Wahl zwischen zentraler und dezentraler Verteilung hängt von der Rechenzentrumsarchitektur ab.

Die Installation selbst profitiert von vorkonfektionierten Systemen mit werksseitig getesteten Komponenten. Moderne Spleißmodule reduzieren die Installationszeit um bis zu 35 Prozent durch durchdachtes Kabelmanagement und werkzeugfreie Montage.

Häufige Fragen zu KI Rechenzentrum Deutschland und GPU Cluster Glasfaser

Welche Glasfaserdichte benötigt ein modernes KI-Rechenzentrum?

Moderne KI-Rechenzentren benötigen mindestens 96 Fasern pro Höheneinheit für effiziente GPU-Cluster-Vernetzung. Pro 1.000 GPUs entstehen etwa 16.000 Glasfaserverbindungen, die auf minimalem Raum terminiert werden müssen.

Wie unterscheiden sich MPO- und LC-Steckverbinder für AI Infrastruktur?

MPO-Steckverbinder bieten 12 bis 24 Fasern pro Stecker und eignen sich für hochdichte GPU-Verbindungen mit 400G bis 1,6T. LC-Duplex-Verbinder mit 2 Fasern werden für einzelne Server-Verbindungen oder Management-Netzwerke eingesetzt.

Welche Übertragungsgeschwindigkeiten sind 2026 Standard?

Der Standard entwickelt sich von 800 Gbit/s auf 1,6 Tbit/s pro Verbindung. Erste Installationen mit 3,2 Tbit/s befinden sich bereits in der Pilotphase bei großen Cloud-Anbietern.

Wie wirkt sich Flüssigkeitskühlung auf die Glasfaserinstallation aus?

Flüssigkeitskühlung erfordert temperaturbeständige Kabel bis 70°C und wasserdichte Durchführungen nach Schutzart IP65. Die Kabelführung muss getrennt von Kühlungsleitungen erfolgen und Wartungszugang gewährleisten.

Welche Normen gelten für Rechenzentrumsverkabelung?

Maßgeblich sind IEC 61754 für Steckverbinder, IEC 61753 für passive Komponenten und DIN EN 50173-1 für die Verkabelungsstruktur. Die Einfügedämpfung muss unter 0,25 dB liegen.

Wie lange dauert die Installation eines 288-Faser-Systems?

Mit vorkonfektionierten modularen Systemen und Ribbon-Spleißtechnik kann ein 288-Faser-System in 8-12 Stunden komplett installiert und getestet werden – eine Zeitersparnis von 35% gegenüber konventionellen Methoden.

Fazit: Die Zukunft der AI Infrastruktur in Deutschland

KI Rechenzentrum Deutschland, GPU Cluster Glasfaser und AI Infrastruktur stehen vor enormen Wachstumsraten. Die Vervierfachung der Kapazitäten bis 2030 erfordert innovative Glasfaserlösungen mit höchster Dichte und Flexibilität. Modulare Spleißsysteme mit bis zu 288 Fasern und Unterstützung für 3,2 Terabit-Übertragungsraten bilden das Rückgrat dieser Entwicklung.

Der Erfolg deutscher KI-Rechenzentren hängt maßgeblich von der richtigen Glasfaserinfrastruktur ab. Mit durchdachten modularen Systemen, professioneller Planung und zukunftssicherer Technologie lassen sich die Herausforderungen der exponentiell wachsenden GPU-Cluster meistern. Als Hersteller und Diamond-Partner bietet Fiber Products die komplette Systemlösung für diese anspruchsvollen Anforderungen – von der Spleißbox bis zum E2000-Konnektor in bewährter Schweizer Präzisionsqualität.

“`

Direkt im Shop bestellen: fiber-products.de

Jetzt Angebot anfragen

Kostenlose Beratung – Persönliches Angebot in 24 Stunden