KI-Rechenzentren 2026: Glasfaser-Anforderungen für GPU-Cluster und AI

KI-Rechenzentren 2026: Glasfaser-Anforderungen für GPU-Cluster und AI

KI-Rechenzentren stellen 2026 völlig neue Anforderungen an die Glasfaser-Infrastruktur: 1,6-Terabit-Verbindungen werden zum Standard, während GPU-Cluster hochdichte Lichtwellenleiter-Systeme mit über 9.000 Fasern pro Rack benötigen.

Der Übergang von KI-Training zu industrieller Inferenz in Hyperscale-Rechenzentren stellt völlig neue Anforderungen an die Glasfaserinfrastruktur. Modulare Systeme mit bis zu 96 Fasern auf 1HE und Latenzen unter 1 Millisekunde werden zur Grundvoraussetzung für leistungsfähige GPU-Cluster.

Technische Grundlagen: Warum KI-Rechenzentren andere Glasfaserarchitekturen benötigen

KI-Workloads unterscheiden sich fundamental von traditionellen Rechenzentrumsanwendungen. GPU-Cluster für maschinelles Lernen erzeugen massive parallele Datenströme mit extremen Bandbreitenanforderungen. Ein einzelner GPU-Server kann heute bereits 8 x 200G-Verbindungen benötigen – Tendenz steigend.

Die Besonderheit liegt in der Kommunikationsstruktur: Während klassische Anwendungen hauptsächlich Nord-Süd-Verkehr erzeugen, dominiert bei KI-Clustern der Ost-West-Verkehr zwischen GPUs. Dies führt zu einer exponentiellen Steigerung der benötigten Faserverbindungen innerhalb des Rechenzentrums.

- Traditionelle Architektur: 48 Fasern pro Rack ausreichend

- KI-GPU-Cluster 2024: bis 3.000 Fasern pro Rack

- KI-Hyperscaler 2026: über 9.000 Fasern pro Rack erforderlich

- Latenzanforderungen: < 1 Mikrosekunde zwischen GPUs im selben Cluster

- Verlustbudget: maximal 0,25 dB pro Verbindung für fehlerfreie Übertragung

Aktuelle Marktentwicklung im DACH-Raum für KI-Infrastruktur

Die Deutsche Telekom investiert jährlich Milliarden in den Ausbau KI-fähiger Glasfaserinfrastruktur. Besonders Frankfurt entwickelt sich zum zentralen Hub für KI-Rechenzentren in Europa, mit direkten Verbindungen zu Amsterdam und London über neue Tiefseekabel.

| Standort | KI-Kapazität 2024 | Geplante Erweiterung 2026 | Glasfaserdichte |

|---|---|---|---|

| Frankfurt | 450 MW | 850 MW | bis 12.000 Fasern/Rack |

| München | 180 MW | 380 MW | bis 8.000 Fasern/Rack |

| Hamburg | 120 MW | 320 MW | bis 6.000 Fasern/Rack |

| Berlin | 200 MW | 450 MW | bis 9.000 Fasern/Rack |

Die Nationale Rechenzentrumsstrategie der Bundesregierung fördert gezielt Investitionen in KI-fähige Infrastruktur. Eurofiber baut parallel latenzoptimierte Routen zwischen den wichtigsten Rechenzentrumsstandorten aus, essentiell für verteiltes KI-Training im DACH-Raum.

Glasfasertypen und Steckersysteme für GPU-Cluster-Netze

Die Wahl der richtigen Glasfaser und Steckersysteme ist entscheidend für die Performance von KI Rechenzentrum Glasfaser-Installationen. Singlemode-Fasern nach ITU-T G.652.D bleiben Standard, während für kürzere Distanzen innerhalb des Clusters zunehmend OM5-Multimode zum Einsatz kommt.

- OS2 Singlemode: Unbegrenzte Bandbreite, ideal für Spine-Leaf-Architekturen

- OM5 Multimode: Kosteneffizient für Verbindungen bis 100 Meter

- Hohlkernfasern: 30% geringere Latenz, ab 2026 in ersten Produktivsystemen

- Biegeunempfindliche Fasern nach G.657.A2: Essentiell für hochdichte Verkabelung

Bei den Steckersystemen dominieren MPO/MTP-Verbinder für die schnelle Skalierung. Für kritische Einzelverbindungen setzen führende Rechenzentren auf E2000-Konnektoren mit ihrer überlegenen Rückflussdämpfung von >85 dB.

Fiber Products Qualitätsversprechen: Als offizieller Diamond-Partner und Hersteller fertigen wir modulare Spleißsysteme in Europa. Profitieren Sie von Schweizer Präzision und 5 Jahren Garantie auf unsere Systeme.

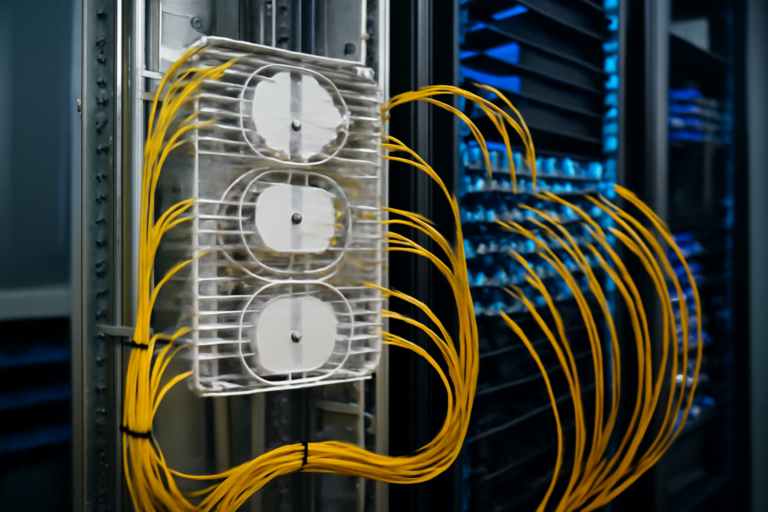

Hochdichte-Spleißsysteme: Der Schlüssel zur Skalierbarkeit

Modulare Spleißsysteme bilden das Rückgrat jeder KI-Rechenzentrumsinfrastruktur. Die Anforderungen an Packungsdichte und Flexibilität erreichen 2026 neue Dimensionen: bis zu 288 Fasern auf 3HE werden zum Mindeststandard.

Die Herausforderung liegt nicht nur in der reinen Faserzahl, sondern in der gleichzeitigen Gewährleistung von Zugänglichkeit und Wartbarkeit. Moderne Systeme wie VarioConnect ermöglichen den Einzelfaserzugriff ohne Beeinträchtigung benachbarter Verbindungen – kritisch bei laufendem GPU-Cluster-Betrieb.

| Systemtyp | Höheneinheiten | Max. Fasern | Fasern pro HE | Eignung für KI |

|---|---|---|---|---|

| SlimConnect | 1HE | 96 | 96 | Edge-KI-Systeme |

| VarioConnect | 3HE | 288 | 96 | GPU-Cluster |

| VarioConnect XL | 4HE | 384 | 96 | Hyperscaler |

Thermomanagement und Kabelführung bei 300kW-Racks

KI-Racks mit über 300 kW Leistungsaufnahme stellen völlig neue Anforderungen an die Kabelführung. Die Glasfaserinfrastruktur muss mit Flüssigkühlsystemen koexistieren, ohne die Luftströme zu behindern oder Wartungsarbeiten zu erschweren.

Vorkonfektionierte Hochdichte-Baugruppen reduzieren das Kabelvolumen um bis zu 70 Prozent gegenüber Einzelfaserinstallationen. Dies schafft den notwendigen Raum für Kühlungsleitungen und verbessert gleichzeitig die Übersichtlichkeit.

- Einsatz von Mikrokabeln mit 2mm Durchmesser für maximale Raumnutzung

- Trennung von Glasfaser- und Stromführung zur EMV-Optimierung

- Redundante Faserführung über getrennte Wege für höchste Verfügbarkeit

- Farbcodierung nach TIA-606-C für schnelle Fehleridentifikation

- Dokumentation jeder Faser in digitalen Zwillingen

CPO-Vorbereitung: Co-Packaged Optics als nächste Evolution

Co-Packaged Optics (CPO) integrieren optische Transceiver direkt in GPU- und Switch-Chips. Diese Technologie verspricht 80 Prozent Energieeinsparung bei der Signalübertragung und wird ab 2026 erste Produktivumgebungen erreichen.

Die Vorbereitung der Glasfaserinfrastruktur für CPO erfordert bereits heute strategische Entscheidungen. Rechenzentren müssen ihre Verkabelung so auslegen, dass ein späterer Übergang ohne kompletten Umbau möglich ist.

Modulare Systeme mit austauschbaren Frontplatten bieten hier entscheidende Vorteile. Die Möglichkeit, von MPO auf neue VSFF-Stecker umzurüsten, ohne die gesamte Infrastruktur zu erneuern, spart Millionenbeträge bei der Migration.

Normen und Standards für KI-Glasfaserinfrastruktur 2026

Die Standardisierung hinkt der technischen Entwicklung hinterher. Während IEEE 802.3 noch an 1,6T-Standards arbeitet, implementieren führende Hyperscaler bereits proprietäre 3,2T-Lösungen. Für Planer bedeutet dies erhöhte Sorgfalt bei der Systemauswahl.

- IEC 61754-15: Neue Anforderungen an E2000-Stecker für KI-Umgebungen

- TIA-942-C: Überarbeitete Rechenzentrumsstandards mit KI-Fokus

- ISO/IEC 11801-6: Verkabelung für verteilte Gebäudeautomation

- EN 50173-6: Europäische Norm für Rechenzentrumsverkabelung

- ANSI/TIA-568.3-E: Optische Übertragungsstrecken für hohe Bandbreiten

Besonders kritisch ist die Einhaltung der Dämpfungsbudgets. Bei 400G und höher tolerieren Transceiver maximal 1,5 dB Gesamtverlust – jede zusätzliche Verbindung muss sorgfältig geplant werden.

Praktische Implementierung: Vom Design zur Installation

Die Planung einer KI Rechenzentrum Glasfaser-Infrastruktur beginnt mit der präzisen Bedarfsanalyse. GPU-Cluster benötigen nicht nur hohe Bandbreite, sondern auch deterministische Latenz und minimale Paketverluste.

Ein typisches Design für einen 8-GPU-Server-Cluster erfordert mindestens 64 Singlemode-Fasern für die Interconnects plus zusätzliche Verbindungen für Management und Redundanz. Die Diamond-Spleißboxen bieten hier mit ihrer modularen Bauweise maximale Flexibilität.

| Planungsschritt | Zeitaufwand | Kritische Faktoren | Werkzeuge |

|---|---|---|---|

| Bedarfsanalyse | 2-3 Wochen | GPU-Anzahl, Topologie | Netzwerksimulation |

| Systemdesign | 3-4 Wochen | Skalierbarkeit, Redundanz | CAD-Planung |

| Installation | 4-6 Wochen | Präzision, Tests | OTDR, Leistungsmesser |

| Inbetriebnahme | 1-2 Wochen | Dokumentation | Zertifizierung |

Messtechnik und Qualitätssicherung für GPU-Cluster-Netze

Die Qualitätssicherung bei AI Data Center LWL-Installationen erfordert hochpräzise Messtechnik. Jede Verbindung muss einzeln zertifiziert werden – bei 9.000 Fasern pro Rack eine erhebliche Herausforderung.

Moderne OTDR-Geräte mit automatischer Auswertung reduzieren den Zeitaufwand pro Faser auf unter 30 Sekunden. Die Dokumentation erfolgt digital mit direkter Übertragung in Managementsysteme.

- Dämpfungsmessung bei 1310nm und 1550nm für Singlemode

- Rückflussdämpfung mindestens 50 dB für Standardanwendungen

- Chromatic Dispersion-Tests für Verbindungen über 10km

- Polarisationsmodendispersion (PMD) für 100G und höher

- Endflächeninspektion mit 400-facher Vergrößerung

Wartung und Lifecycle-Management in KI-Umgebungen

KI-Rechenzentren operieren mit Verfügbarkeitsanforderungen von 99,999 Prozent. Wartungsfenster sind praktisch nicht existent, weshalb die Glasfaserinfrastruktur höchste Zuverlässigkeit bieten muss.

Präventive Wartung umfasst regelmäßige Reinigung der Steckverbindungen, Überprüfung der Biegeradien und Monitoring der Dämpfungswerte. Moderne Systeme integrieren optische Überwachung direkt in die Infrastruktur.

Die erwartete Lebensdauer von Glasfaserinstallationen liegt bei über 25 Jahren. Allerdings erfordern die steigenden Bandbreitenanforderungen alle 3-5 Jahre Updates der aktiven Komponenten. Modulare Systeme mit 5 Jahren Garantie bieten hier Investitionssicherheit.

Zukunftsausblick: KI-Infrastruktur 2028 und darüber hinaus

Die Entwicklung der KI Rechenzentrum Glasfaser-Technologie beschleunigt sich weiter. Experten prognostizieren für 2028 erste kommerzielle Implementierungen von 6,4T-Verbindungen und Faserdichten von über 20.000 pro Rack.

- Quantencomputer-Integration erfordert spezielle Singlemode-Fasern

- Photonische Prozessoren eliminieren elektrisch-optische Wandlung

- KI-gesteuerte Netzwerkoptimierung in Echtzeit

- Selbstheilende Glasfasernetze durch redundante Pfade

- Integration von Sensorik in jede Faser für präzises Monitoring

Der DACH-Markt ist durch seine zentrale Lage in Europa und die starke Industriebasis optimal positioniert. Die Investitionen in Glasfaserinfrastruktur schaffen die Grundlage für die digitale Souveränität Europas im KI-Zeitalter.

FAQ: Häufige technische Fragen zu KI-Glasfaserinfrastruktur

Welche Faserzahl benötigt ein typischer 8-GPU-Server?

Ein 8-GPU-Server mit aktueller Architektur benötigt mindestens 64 Singlemode-Fasern für die GPU-Interconnects, plus 16 Fasern für Uplinks und 8 Fasern für Management – insgesamt also 88 Fasern. Mit Redundanz empfehlen wir 96 Fasern, was exakt der Kapazität eines SlimConnect 1HE-Moduls entspricht.

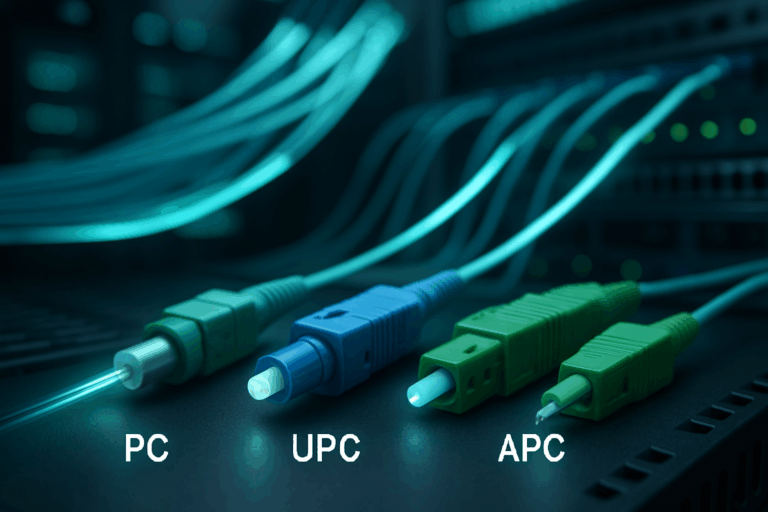

Wie unterscheiden sich APC- und PC-Stecker bei KI-Anwendungen?

APC-Stecker (Angled Physical Contact) bieten eine Rückflussdämpfung von >65 dB, während PC-Stecker nur 45-50 dB erreichen. Für KI-Anwendungen mit empfindlichen Kohärenten Transceivern sind APC-Stecker obligatorisch, um Signalreflexionen zu minimieren.

Welche Rolle spielen Spleißmodule bei der CPO-Migration?

Modulare Spleißsysteme ermöglichen den schrittweisen Übergang zu CPO ohne Komplettaustausch. Durch austauschbare Frontplatten können bestehende MPO-Verbindungen auf neue VSFF-Standards umgerüstet werden. Die Investition in hochwertige Spleißmodule mit 5 Jahren Garantie sichert die Zukunftsfähigkeit.

Wie kritisch ist die Einhaltung der Biegeradien bei Hochgeschwindigkeitsverbindungen?

Bei 400G und höher führen Unterschreitungen des Mindestbiegeradius von 30mm (G.657.A2) zu messbaren Paketverlusten. Moderne biegeunempfindliche Fasern tolerieren 15mm, was in hochdichten Umgebungen entscheidende Vorteile bietet.

Welche Messtechnik ist für die Abnahme von GPU-Cluster-Verkabelung erforderlich?

Mindestens erforderlich sind: OTDR mit 1m Auflösung, Leistungsmessgerät für 1310/1550nm, Mikroskop mit 400x Vergrößerung für Endflächeninspektion und ein Chromatic Dispersion Analyzer für Strecken über 2km. Die Gesamtinvestition liegt bei etwa 25.000-35.000 Euro.

Wie lassen sich Ausfallzeiten bei Wartungsarbeiten minimieren?

Durch konsequente A/B-Pfad-Redundanz und den Einsatz modularer Systeme wie VarioConnect. Die Möglichkeit, einzelne Kassetten im laufenden Betrieb zu tauschen, reduziert Wartungsfenster auf unter 5 Minuten pro Modul.

Fazit: Strategische Weichenstellung für KI-fähige Glasfasernetze

Die Transformation zu KI Rechenzentrum Glasfaser, GPU Cluster Netz und AI Data Center LWL-Infrastrukturen erfordert mehr als nur höhere Bandbreiten. Es geht um eine fundamentale Neuausrichtung der optischen Netzarchitektur mit Fokus auf ultraniedrige Latenz, maximale Packungsdichte und absolute Zuverlässigkeit.

Erfolgreiche Implementierungen setzen auf modulare, skalierbare Systeme mit nachgewiesener Qualität. Die Wahl von Herstellern mit

Jetzt Anfrage stellen

Sie haben Fragen zu unseren Glasfaserlösungen? Unser Expertenteam berät Sie gerne – kostenlos und unverbindlich.